C’est une guerre sans bruit ni fureur qui fait rage depuis quelques années. Mais elle entraîne des conséquences néfastes et dramatiques pour les nations, leurs entreprises et leurs citoyens. La guerre de l’information frappe tous azimuts et déstabilise nos démocraties. Or, dans ce conflit silencieux, l’intelligence artificielle est devenue un outil très efficace pour désinformer et tromper, mais aussi et surtout pour lutter contre les deepfakes, fake news et autres manipulations. C’est la « guerre des IA ». Analyse.

La lutte informatique d’influence à l’heure de

l’intelligence artificielle

Les armes sophistiquées que constituent les technologies de deepfake et la production de fausses informations ont émergé comme des instruments de choix dans les conflits, armés ou pas, et sont employés pour déstabiliser des États, des groupes sociaux ou ternir la réputation d'entreprises. Leur utilisation croissante suscite des préoccupations majeures, surtout en période électorale. Un récent sondage révèle une forte inquiétude au sein de la population française : 77% des interrogés estiment que la propagation de fausses informations a un impact considérable sur le fonctionnement démocratique, et 72% redoutent l'influence de la désinformation sur les réseaux sociaux sur le vote. Par ailleurs, plus de la moitié (55%) craint une contestation potentielle des résultats des élections européennes en raison d'une campagne de désinformation éventuelle.

En 2021, 51% des utilisateurs d’Internet en France déclaraient avoir vu au moins une information qu’ils jugeaient fausse ou peu fiable (infox) au cours des trois derniers mois sur des sites d’informations ou des médias sociaux. Déjà en 2019, une étude publiée par Visabrain révélait l’explosion des fake news sur les réseaux : cinq fois plus de tweets comportant ou parlant des fake news au niveau mondial et deux fois plus en France entre 2016 et 2017 ; 45,5 millions de tweets relayant ou commentant une fake news dans le monde en 2019 et 1,7 million rien qu’en France. En 2023, l’organisme News Guard révélait avoir recensé près de 800 sites créés la même année qui ne diffusaient que des fake news générées par l’IA générative.

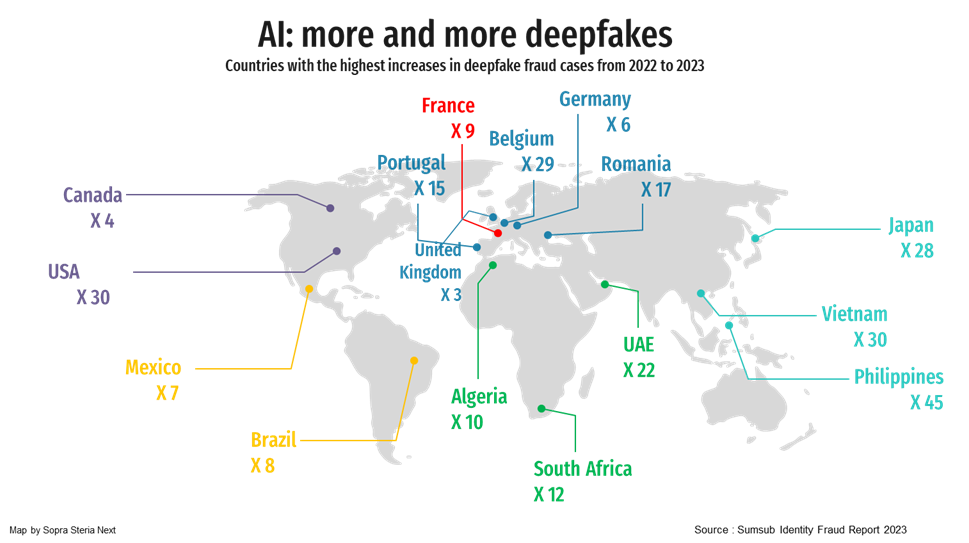

L’Europe est également et massivement frappée par le phénomène des deepfakes générées par l’intelligence artificielle avec, par exemple, une multiplication de leur nombre par près de huit dans le cadre de la fraude à l’identité, entre 2022 et 2023.

Dans un contexte particulièrement tendu avec la guerre en Ukraine, le conflit au Proche-Orient et les élections européennes et américaines cette année, le phénomène, qui ne cesse de s’amplifier, inquiète de plus en plus, surtout avec l’apport des nouvelles technologies et notamment de l’intelligence artificielle générative.

Or, depuis 2022, l'intelligence artificielle générative, capable de produire du texte, des images ou des vidéos, est omniprésente et largement accessible. Les grands modèles de langage optimisés pour la conversation sont capables de générer toute sorte de contenu falsifié. Des comptes sur les réseaux sociaux tels que Facebook, X (anciennement Twitter), Instagram, etc., peuvent ainsi être alimentés par des IA génératives pour mener des campagnes de désinformation. Des fausses informations peuvent être générées à l'aide d'outils tels que les transformers de type GPT-3 ou les GAN (Generative Adversarial Networks) pour produire des images d'un grande réalisme.

Le ministère de l'Intérieur souligne d’ailleurs que « les opérations d'ingérence étrangère visant à déstabiliser les États se multiplient et représentent une véritable menace pour les démocraties. »

Face à cette « insécurité informationnelle », le développement de réponses efficaces s'avère complexe mais se fondera sans doute sur l’intelligence artificielle, associée à l’analyse humaine, binôme d’avenir pour anticiper, détecter ou identifier, puis répondre et contre-attaquer.

L’IA pour cartographier et analyser les circuits et les messages de la désinformation

Autrefois, la compréhension de la construction des réseaux sociaux, de la diffusion des messages qu'ils véhiculaient et de l’origine des sources représentaient une entreprise difficile, voire insurmontable. L'avènement de l'intelligence artificielle offre désormais un levier puissant pour répondre à ces défis en amont.

L'analyse du contenu diffusé et relayé peut être réalisée grâce au traitement naturel du langage (NLP). Divers outils de classification, tels que les forêts d'arbres décisionnels ou les réseaux de neurones LSTM, facilitent la traduction automatique. De même, la technologie des graphes est utilisée pour disséquer les relations entre les données, exploitant le potentiel de l'intelligence artificielle. De son côté, l’apprentissage automatique permet de créer des outils pour détecter les manipulations et les transformations d’image, en recherchant par exemple les traces laissées par les appareils de capture d’images altérées par les algorithmes de retouche.

Par ailleurs, il est possible d’entraîner l’IA à déceler la désinformation sur les réseaux sociaux et les groupes de messageries afin d’émettre un avertissement. La création de blocs de données provenant d’échanges sur les réseaux comme Twitter ou Telegram permet à l’IA de reconnaître des éléments stylistiques typiques des fake news. Elle peut également être entraînée à relever les contenus potentiellement problématiques et ainsi aider les opérateurs à comprendre les motifs de déclenchement de l’alerte. La connaissance et la formation sont capitales dans la compréhension des impacts technologiques pour l’évolution des métiers et complètent le travail fourni par l’intelligence artificielle, dès lors dans un rôle de « copilote » avec l’homme.

Enfin, en aval, la toute nouvelle « loi IA » votée par l’Union européenne doit encadrer les deepfakes en imposant à ceux qui mettent en œuvre des systèmes d’IA générant ou manipulant du contenu (image, audio ou vidéo), d’indiquer si ce contenu a été artificiellement créé ou modifié. Néanmoins, le seul arsenal législatif ne nous protège pas de manière absolue contre les nombreuses opérations de désinformations menées par nos compétiteurs, raisons pour laquelle la lutte contre la désinformation doit être menée avec les « armes » de nos adversaires - les technologies d’intelligence artificielle – et reposer sur des valeurs fortes au service de la Nation.

Des valeurs fortes au service de la Nation

Comme le préconisait le dernier rapport de l’OCDE publié le 4 mars dernier, il est nécessaire d’établir une stratégie nationale permettant une meilleure organisation des efforts. Il est par ailleurs indispensable de construire un outil d'observation de la désinformation sur les réseaux sociaux, en vue d’informer en permanence les citoyens des tentatives d'ingérence en cours. Le développement de l’esprit critique des individus pour les rendre plus résilients face aux tentatives de manipulation (sensibilisation scolaires, création d’outils adaptés) est également capital.

Développer des outils innovants l’est aussi, certes, mais ceux-ci doivent être conformes au Droit et aux règles éthiques associées(car c’est bien ce qui nous différencie de nos adversaires). Ces outils doivent également faciliter la synergie entre les intelligences humaine et artificielle afin de distinguer les faits et les fausses informations ou le repérage de deepfakes.

Il s’agit également de développer un environnement de confiance entre les différentes acteurs (chercheurs, professionnels et politiques) et un écosystème d’excellence basé sur la coopération entre l’État, les start-up, les grands groupes, les entreprises de service numérique et les membres de la BITD.

Enfin, les solutions d’IA doivent être souveraines pour permettre à la France de jouer les premiers rôles à l’échelle mondiale. Dans un monde de plus en plus instable avec des compétiteurs totalement désinhibés, le rôle de l’intelligence artificielle, associée à une fine analyse humaine, va rester majeur dans la lutte informationnelle et, ce faisant, dans la protection de nos démocraties. La souveraineté et l’autonomie technologique, c’est-à-dire l’indépendance numérique de l’UE envers les technologies étrangères, doivent donc être recherchées, à la fois en formant de nombreux ingénieurs, en attirant les meilleurs talents dans toutes nos entreprises mais aussi en encourageant la recherche fondamentale et la mise en place d’écosystèmes industriels sécurisés et adaptés.

[1] L’étude a été réalisée par l’institut de sondage IPSOS pour Sopra Steria. Les enquêtes ont été menées du 21 au 23 février 2024 sur un panel de 1000 personnes, représentatif de la population française (sexe, âge, profession, région, catégorie d’agglomération). L’échantillon a été interrogé par internet via l’Access Panel Online d’Ipsos. Voir La population française vulnérable à la désinformation (soprasteria.fr)

[2] https://www.insee.fr/fr/statistiques/6475020#figure1

[3] Fake News : comment se protéger ? (visibrain.com)

[4] https://www.lopinion.fr/economie/les-entreprises-futures-proies-des-fake-news

[5] https://www.newsguardtech.com/special-reports/ai-tracking-center/

[6] À titre d’exemple, l’utilisation des deepfakes pour la fraude à l’identité a explosé en 2023. La Lettonie détenait le record européen avec près de 76 100 personnes touchées sur une population de 1,8 million d’habitants alors que Malte était la moins touchée avec 3 700 personnes exposées sur 531 113 habitants. La France se classait huitième avec un million de personne touchées pour près de 68 millions d’habitants. Sumsub Identity Fraud Report A comprehensive, data-driven report on identity fraud dynamics and innovative prevention methods, 2023, p. 55.

[7] La lutte contre la manipulation de l’information | Direction Générale de la Sécurité Intérieure (interieur.gouv.fr)

[8] Long short-term memory ou réseau de mémoire à long et court termes. Il permet d’aider à reconnaître les textes manuscrits. Le système peut analyser et distinguer les modèles d'écriture afin d'identifier correctement le texte. Cela permet de l'utiliser par exemple dans les programmes de traitement de texte pour la saisie manuscrite.

[9] Cette solution a été adoptée par le ministère des Affaires étrangères allemand.

[10] Principes de proportionnalité et d’innocuité, sûreté et sécurité, droit au respect de la vie privée et protection des données, gouvernance et collaboration multipartites et adaptatives, responsabilité et redevabilité, transparence et explicabilité, surveillance et décision humaine, durabilité, sensibilisation et éducation et équité et non-discrimination.

Auteurs :

Julien ROUXEL, Partner ED&S Espace, Défense & Sécurité, Sopra Steria Next,

Bruno COURTOIS, Conseiller Défense & Cyber, Sopra Steria Défense & Sécurité,

Boris LAURENT, Manager Conseil, Sopra Steria Next.